Secondo quanto riportato da fonti ufficiali dell’UE, il volume dei dati prodotti nel mondo dovrebbe passare da 33 zettabyte (un zettabyte equivale a mille miliardi di gigabyte) nel 2018 a 175 zettabyte nel 2025. Queste cifre fanno capire quanto sia sempre più urgente avere una strategia per i dati, e come la loro mole può trarne notevole vantaggio in termini di gestione, rielaborazione e utilizzo rifacendosi a tecnologie come Machine Learning e Intelligenza Artificiale (AI). Volendo conquistarsi un ruolo guida nell'economia dei dati e consapevole dell’ingente impatto dell’AI e sulla sua natura pervasiva in moltissimi campi, il Parlamento europeo ha istituito una commissione (l’acronimo con cui è conosciuta è AIDA – Artificial Intelligence in a Digital Age) per esaminare l’impatto della tecnologia e ha richiesto per una legislazione IA antropocentrica e proiettata verso il futuro.

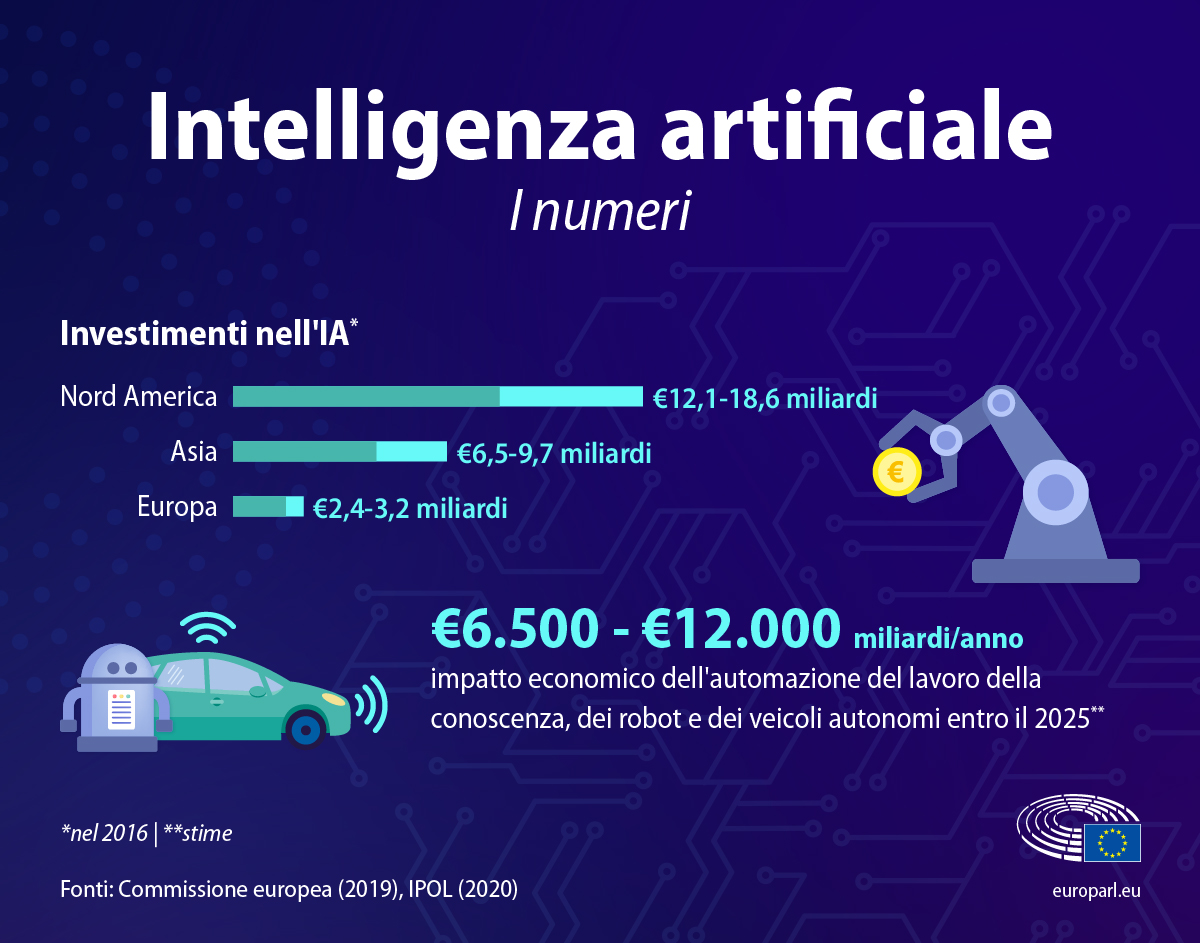

Cercando di capire e quantificare, quanto a livello di UE si stia investendo, sia in termini di attenzione che di vere e proprie risorse economiche, AI rientra nel programma Europa digitale che il Parlamento europeo ha votato in occasione della plenaria di aprile 2021: si tratta del primo strumento finanziario dell’UE creato ad hoc per portare la tecnologia più vicina alle aziende e ai cittadini, investendo nel digitale per facilitare la competitività dell’Europa, la transizione verde e la sovranità tecnologica. Come si legge sul sito dell’Europarlamento (“Importanza, benefici e politiche dell’UE per la trasformazione digitale”), 7,5 miliardi di euro saranno investiti in cinque diverse aree: supercalcolo (2,2 miliardi di euro), intelligenza artificiale (2 miliardi di euro), sicurezza informatica (1,6 miliardi di euro), conoscenze digitali avanzate (577 milioni di euro) e per assicurare un ampio utilizzo di tecnologie digitali nell’economia e nella società (1 miliardo di euro).

Questo programma, nello specifico dell’AI, trova uno dei suoi punti di riferimento legislativi nella strategia europea per l'IA presentata nell'aprile 2018, che in un contesto di forte concorrenza globale, ha lo scopo di esplicitare l’approccio europeo per sfruttare le opportunità e affrontare le sfide derivanti dall'IA. Il quadro strategico (delineato anche in un apposito Libro bianco) che s’intende perseguire stabilisce misure per allineare gli sforzi a livello europeo, nazionale e regionale. Uno dei punti clou della questione sta nella messa a terra di partenariati efficienti ed efficaci tra il settore pubblico e privato, ricalcando le logiche B2G e G2B, dove G sta per Government e B per Business. L'obiettivo di tale quadro è mobilitare risorse per conseguire un ecosistema di eccellenza e fiducia lungo l'intera catena del valore, a cominciare dalla ricerca e dall'innovazione, e creare i giusti incentivi per accelerare l'adozione di soluzioni basate sull'IA, anche da parte delle piccole e medie imprese (PMI).

In questo panorama, tra le molteplici criticità rintracciabili, vale la pena citare, a titolo esemplificativo, anzitutto quelle relative a interoperabilità e qualità dei dati. L'interoperabilità e la qualità dei dati, al pari della loro struttura, autenticità e integrità, sono fondamentali per lo sfruttamento del valore dei dati, in particolare nel contesto della diffusione dell'IA. I produttori e gli utilizzatori di dati hanno individuato gravi problemi di interoperabilità che ostacolano la combinazione di dati provenienti da fonti diverse sia a livello settoriale sia, in misura ancora maggiore, a livello intersettoriale. Ovviamente queste difficoltà di “dialogo” non aiutano un ambito assai delicato, soprattutto quando si fa riferimento alla sua funzione di facilitatore in termini di decision making.

Tenendo a mente che distorsioni e discriminazioni rappresentano un rischio intrinseco di qualunque attività sociale od economica, il processo decisionale umano non è immune da errori e bias. Quando ciò avviene nel perimetro dell’IA, si potrebbero tuttavia avere effetti molto maggiori in assenza dei meccanismi di controllo sociale che disciplinano il comportamento umano. Questo è dovuto alle caratteristiche specifiche di molte tecnologie di IA, tra cui l'opacità (effetto "scatola nera"), la complessità, l'imprevedibilità e un comportamento parzialmente autonomo, possono rendere difficile verificare il rispetto della legislazione in materia.

Tuttavia, una seria presa di coscienza di criticità ed opportunità può aiutare a risolvere e gestire gli effetti indesiderati e rispondendo positivamente ad interrogativi etici, andando a ottimizzare quello che può essere il contributo dell’AI a tutto tondo (dal business alla prevenzione del crimine, pubblica sicurezza, salute, ecc.). In tal senso, proprio per ribadire una riflessione in termini di “costi-benefici”, vale la pena riportare alcune righe riassuntive sulla genesi dell’AI, tratte dall’executive summary del volume “L’intelligenza artificiale per lo sviluppo sostenibile”, redatto grazie ai contributi di CISV, Associazione Italiana per l’Intelligenza Artificiale (AIxIA), e del Dipartimento d’Informatica dell’Università degli Studi “Aldo Moro” di Bari: “I primi segnali dell’IA moderna risalgono al 1943 con un articolo che descrive come potrebbe funzionare un neurone artificiale. Il nome risale al 1955, contenuto nella proposta di realizzazione di un convegno estivo tenuto nel 1956 a Dartmouth. Da allora si sono evidenziati una serie di periodi di entusiasmo per un singolo paradigma, seguiti da periodi di delusione per i limiti successivamente riscontrati. Oggi siamo in nuovo periodo di entusiasmo, in gran parte a seguito dell’utilizzo di reti neurali simulate dotate di molti strati e connessioni. […] Le macchine sono in grado di: 1. percepire la realtà (vedere, sentire, riconoscere configurazioni e fare diagnosi); 2. imparare da esempi; 3. ragionare; 4. fare innovazione, realizzando nuove soluzioni in campo scientifico e artistico. Il limite principale delle macchine rimane la capacità di astrazione e su questo si sta concentrando la ricerca. Con queste capacità l’Intelligenza Artificiale risulta una tecnologia che ha impatto e ne avrà ancora di più in futuro in moltissimi contesti: l’economia, il lavoro, l’apprendimento, la comunicazione, la salute, l’ambiente, la democrazia, ecc.”

Da queste poche righe emerge l’enorme potenziale anche in campi non immediatamente associabili al mondo AI. Interessante, in tal senso, un contributo di Indigo.ai che esplicita come l’intelligenza artificiale, soprattutto quella “conversazionale”, ovvero quella che è in grado di interagire con le persone attraverso conversazioni vocali o scritte – si pensi ad esempio agli assistenti virtuali (Alexa) o ai chatbot, possa venire in aiuto per gestire situazioni di polarizzazione dell’opinione pubblica, circoli viziosi di propaganda, fino a vere e proprie fake news.

Sebbene l’intelligenza artificiale non possa sostituirsi al pensiero umano, può contribuire a farlo nel modo corretto: spesso, infatti, la polarizzazione delle opinioni deriva dal fatto che non si è in grado di riconoscere gli errori logici altrui o propri. Dato che la maggior parte delle persone non ha studiato le tecniche del dibattito, la retorica o la logica, potrebbe essere particolarmente utile un “assistente” che venga in aiuto quando si interagisce online e che sia in grado di evidenziare immediatamente la fallacia di un ragionamento. Nelle parole di Indigo.ai, “[..] discernere il vero dal falso, a prescindere da quelle che siano le opinioni personali. Un assistente sotto forma di app che possa darci qualche lezione semplice e pratica di logica, che possa eventualmente collegarsi ai nostri social se lo vogliamo, per aiutarci a scovare le fallacie, o che sia anche solo consultabile mandandogli un link via chat”.

Di fatti, l’AI risulta funzionale nel superamento degli ostacoli psicologici, espressi dalle “trappole cognitive ed emotive”, che molto spesso compromettono la razionalità dei soggetti impegnati in dibattiti, ma anche in trattative e negoziazioni, specialmente nella scelta delle informazioni da utilizzare. In questi casi, l’affiancamento di un assistente virtuale, non soggetto allo stress emotivo e all’influenza di un sistema di credenze, anzi, immune da emozioni e frustrazioni, può favorire la logica del dibattito o del negoziato.

Il raggio d’azione dell’AI è potenzialmente amplissimo e bisognerà continuare ad interrogarsi su come in progressi nell’ambito possono essere utilizzati in maniera funzionale e positiva, evitando le derive più opache ed eticamente controverse.